Inhaltsverzeichnis

Liebe Leser, liebe Kunden, Sie fragen sich möglicherweise, warum wir erneut einen Beitrag zur Klärung der in der Überschrift genannten Begrifflichkeiten veröffentlichen. Kurz gesagt, wir wollen Ihnen eine Definition zu Augmented Reality geben, und damit eine präzise Vorstellung von dem, womit wir uns beschäftigen und so Unklarheiten und Missverständnisse so früh wie möglich beseitigen. Als Unternehmen, das in der XR-Branche arbeitet, ist uns die Nähe zur Wissenschaft besonders wichtig. In diesem Feld gibt es konstant neue Entwicklungen und um hier nicht den Überblick zu verlieren, sind klare Definitionen und Differenzierungen nötig. Doch was genau ist jetzt xReality (XR)? Die Antwort darauf gibt uns das Kapitel What is XR? Towards a Framework for Augmented and Virtual Reality aus der doppelt-blind begutachteten Fachzeitschrift Computers in Human Behavior. Prof. Dr. Rauschnabel von der Universität der Bundeswehr München räumt hier zusammen mit renommierten Kollegen im Wirrwarr der Realitätsbegrifflichkeiten auf.

Der Rahmen von AR und VR.

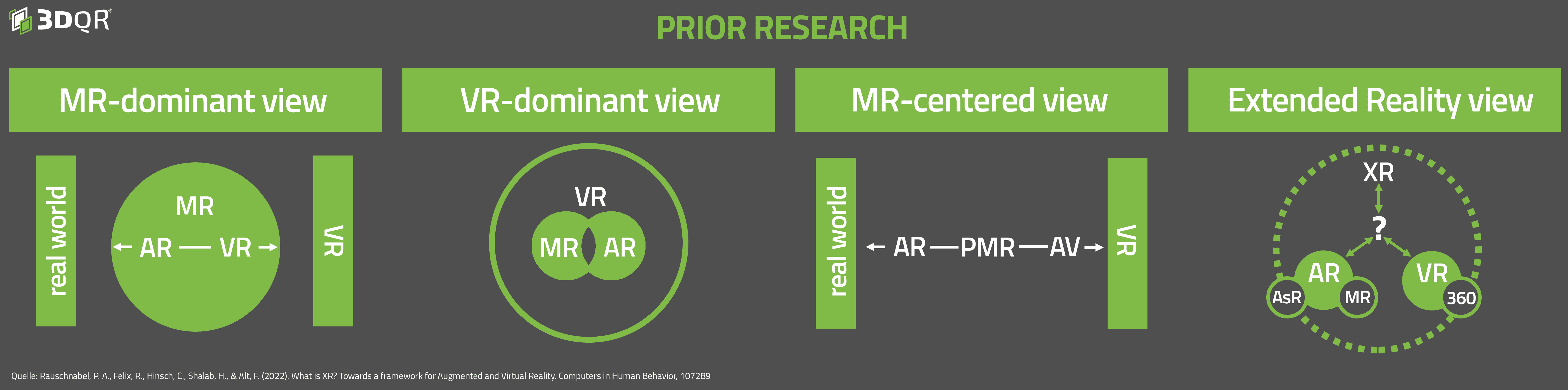

Herr Prof. Dr. Rauschnabel und Kollegen haben, um endlich Klarheit zu schaffen, qualitative Interviews mit verschiedenen Experten aus der Branche geführt, damit ein Bild der vorherrschenden Meinungen entstehen konnte. Dabei sind Sie zu folgendem Ergebnis gekommen.

Hier ist deutlich zu erkennen, dass verschiedene dominante Ansichten existieren, welche die gleichen Begriffe unterschiedlich verwenden. Zum Beispiel ist Mixed Reality (MR) mal der Begriff, unter dem alles andere kategorisiert wird, mal ist er aber nur Bestandteil der Augmented Reality (AR). Aus diesem Grund haben die Wissenschaftler rund um Herrn Rauschnabel folgende Lösung vorgeschlagen, welche sich als logische Schlussfolgerung aus den Interviews ergeben hat. Sie nennen es das xReality Framework, welches wie folgt strukturiert ist.

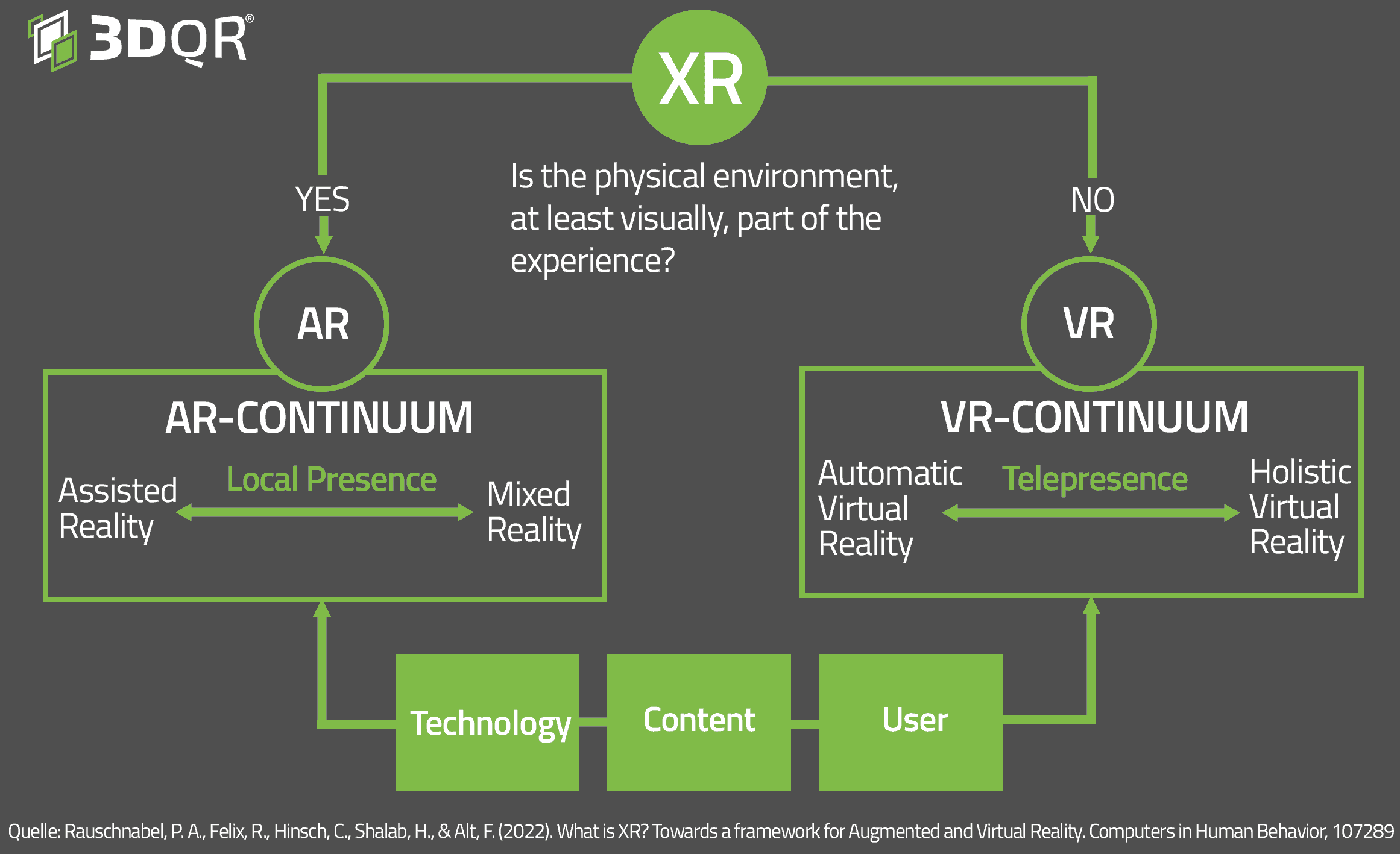

XR bildet hier den Oberbegriff, unter dem sich die Definition zu Augmented- und Virtual Reality unterordnet. Die Neuerung dabei ist, dass der Begriff XR nicht, wie üblich, als Extended Reality bezeichnet wird. Die Autoren diskutieren die Bedeutung des Begriffs “Extended” und schlussfolgern, dass “Extended”, per Definition, VR ausgrenzt. Schließlich wird in VR die Realität nicht “extended” sondern ersetzt. Daher schlagen die Autoren den Begriff xreality vor. Als Kernmechanismus von AR leiten die Autoren das “Local Presence” Konstrukt ab. Dabei handelt es sich um die wahrgenommene Präsenz virtueller Inhalte in der Nähe des Nutzers. Im Gegensatz dazu ist Telepresence das dominierende Unterscheidungskriterium für VR. Im Gegensatz zu Local Presence sind also nicht Inhalte “hier”, sondern der Nutzer “dort” (in einer anderen, rein fiktiven, Umgebung).

Local Presence: Von Assisted Reality bis Mixed Rality.

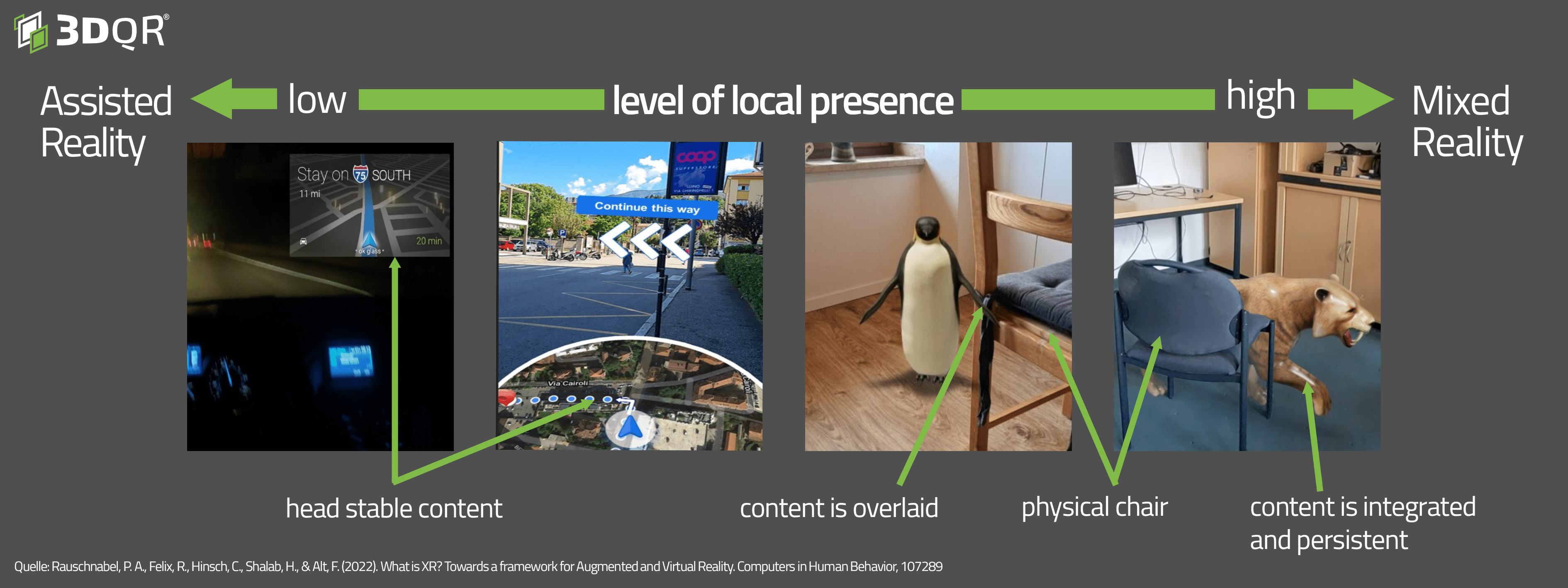

Augmented Reality kann vieles meinen, vom Navigationsgerät über Instagramfilter bis hin zu dreidimensionalen Objekten, die im Raum verankert sind, aber wie ist die Definition? Um aber genauer differenzieren zu können, haben Prof. Dr. Rauschnabel und seine Kollegen folgende Kategorisierung von lokaler Präsenz zusammengefasst.

Am unteren Ende der Skala befindet sich die Assisted Reality. Die hier gezeigt Beispiele sind Navigationssysteme. Ersteres ist ein einfaches Navigationssystem über eine Google Glass Brille. Der in der Abbildung als head stable Content bezeichnete Inhalt bewegt sich entsprechend der Ausrichtung des Kopfes des Nutzers und bleibt immer an der gleichen Stelle. Dies eignen sich für Fälle, in denen keine Beziehung zwischen virtuellen und realen Objekten besteht oder in denen es wichtig ist, dass der Nutzer Informationen schnell und jederzeit verarbeiten kann (vgl. Rauschnabel et al., 2022, S. 8, Übers. d. Verf.).

Im zweiten Bild sehen wir eine AR Navigationsanwendungvon Google Maps auf einem handelsüblichen Smartphone. Hierbei handelt es sich bereits um eine Mischung aus head stable und world stable Content. Letztere sind an einer festen Position im 3D-Raum verankert (hier: die drei weißen Pfeile). Dieser Ansatz wird üblicherweise in Fällen verwendet, in denen eine Beziehung zwischen einem virtuellen und einem physischen Objekt besteht, und ist daher in Mixed-Reality-Anwendungen von großer Bedeutung. Aus technischer Sicht erfordern diese Inhalte eine umfangreiche Tracking-Technologie, damit virtuelle Inhalte im 3D-Raum realistisch und in Übereinstimmung mit realen und virtuellen Objekten gerendert werden können (vgl. Rauschnabel et al., 2022, S. 8, Übers. d. Verf.).

Die anderen beiden Beispiele sind bereits als eher Mixed Reality zu bezeichnen. Hier sehen wir zwei 3D-Modelle von Tieren, beide unterscheiden sich aber im Realismus ihrer Darstellung. Der digitale Pinguin ist im Raum hinter dem Stuhl positioniert, ist jedoch nicht ganz korrekt in die reale Welt eingebunden. Sein rechter Flügel müsste vom Stuhl verdeckt werden. Dieser Fehler ist im letzten Bild behoben. Wir sehen hier eine realistische Darstellung eines virtuellen Säbelzahntigers in einem realen Raum. Der Stuhl verdeckt hier perfekt alles, was sich hinter ihm befindet. Perfekte Mixed Reality ist dann vorhanden, wenn Menschen virtuelle Elemente nicht mehr von realen unterscheiden können – der Grad der “Local Presence” also maximal ist. Allerdings ist es wichtig zu erwähnen, dass Mixed Reality nicht immer besser ist als Assisted Reality. “In vielen Fällen ist es vorteilhaft, wenn Menschen sofort erkennen, welche Inhalte echt und welche es nicht sind; man denke bspw. an Arbeitsanweisungen im Produktionsumfeld”, so Prof. Dr. Rauschnabel auf Anfrage von uns.

Prof. Dr. Philipp A. Rauschnabel ist Professor für digitales Marketing und Medieninnovation an der Universität der Bundeswehr München. Er gehört zu den einflussreichsten XR und Metaverse-Experten in Deutschland. Laut dem Microsoft Academics Ranking ist er unter den Top 5 der zitationsstärksten Augmented Reality Forschern weltweit. Seit 2020 kooperiert er mit 3DQR im Bereich Lehre und Wissenstransfer. Den zitierten Artikel von Prof. Dr. Rauschnabel und seinen Kollegen finden sie hier.

Wir bei 3DQR sind mit unserer 3DQR Plus App direkt am Puls. Kinderleicht lassen sich eigene Augmented Reality Inhalte erstellen und für andere bereitstellen – auch on-the-fly direkt über Ihr Smartphone. Alle AR-Szenen lassen sich dank unserer App überall in bester Qualität in Echtzeit betrachten und direkt beim Betrachten bearbeiten. Durch die intuitive Bedienung lassen sich so schnell und unkompliziert alle Arten von Projekten umsetzen. Unsere Plattform unterstützt alle gängigen Dateiformate – so sind sie bestens ausgerüstet.

Treten Sie mit uns in Kontakt, um mehr über unsere AR-Lösungen zu erfahren: Zum Kontaktformular